Your new post is loading...

|

Scooped by

Yannick Giquel

Today, 2:07 PM

|

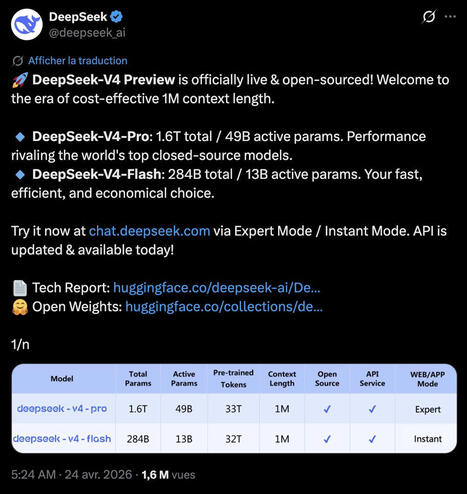

DeepSeek a publié une preview de ses modèles V4, qui ouvrent la voie à une indépendance vis-à-vis de NVIDIA, avec Huawei en palliatif.

|

Scooped by

Yannick Giquel

Today, 11:22 AM

|

Anthropic et la stratégie marketing de la peur autour de sa nouvelle IA Mythos (2/3) Fear, Uncertainty & Doubt Illustration : Flock Le lancement de Mythos Preview, l’IA dédiée à la cybersécurité d’Anthropic, a défrayé la chronique en surfant sur la peur, l’incertitude et le doute concernant ses capacités de détection des failles de sécurité, et le nombre de vulnérabilités qu’elle pourrait identifier. Certains professionnels de la cybersécurité et de l’IA tempèrent cela dit ce marketing de la peur, voire émettent quelques critiques. Jean-Marc Manach Le 24 avril à 16h10 Sécurité 13 min L’intelligence artificielle est un pharmakon tout à la fois susceptible d’empoisonner les systèmes d’information que de tenter les guérir, quand bien même elle semble pour l’instant favoriser les attaquants, comme le souligne la première partie de notre série de trois articles. Sécurité La cybersécurité est une « priorité géopolitique », pas un « problème technique » (1/3) Jeudi 23 avril 2026 à 12h23 6 La chronologie des progrès fulgurants en matière d’identification des vulnérabilités, voire de développement d’exploits, par des IA, montre que Mythos Preview n’est que la cerise sur le gâteau d’un processus entamé il y a plusieurs années. Ce pourquoi il convient aussi de revenir, au-delà de la « hype », sur les principales critiques qui lui ont été associées. « Peur, incertitude et doute » Dans les années 70, le recours par IBM à des discours anxiogènes, voire à de la désinformation, afin de lutter contre la concurrence, avait donné naissance à l’expression « Fear, uncertainty and doubt » (FUD, litt. « peur, incertitude et doute »). Cette rhétorique marketing avait ensuite été notamment utilisée par Microsoft pour diaboliser Linux, accusé d’être un cancer communiste. Le fait que Mythos Preview, l’IA orientée cybersécurité d’Anthropic annoncée le 7 avril dernier, ait d’ores et déjà identifié « des milliers de vulnérabilités critiques », y compris des failles 0-day, est un indéniable « coup de com’ ». S’il ne relève pas stricto sensu du FUD, dans la mesure où il ne diabolise pas ses concurrents, il a bel et bien généré de la peur, de l’incertitude et du doute. IA Anthropic dévoile Mythos, son modèle d’IA chasseur de failles… réservé à certains Mercredi 08 avril 2026 à 15h13 7 Une stratégie assumée par Anthropic qui, au motif qu’il serait trop dangereux de le rendre accessible à tout le monde, en a réservé l’accès à une cinquantaine d’entreprises et organisations états-uniennes en charge d’infrastructures logicielles critiques (dont 11 seulement ont été nommées : AWS, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorganChase, la Linux Foundation, Microsoft, NVIDIA, et Palo Alto Networks), réunies au sein du projet Glasswing, pour éviter tout risque de prolifération non contrôlée. Comme nous le relevions la semaine passée, hors États-Unis, seule l’AI Security Institute (AISI), l’organisme britannique dédié à la sécurité de l’IA, a pour l’instant pu l’évaluer. Plusieurs institutions gouvernementales européennes tentent depuis de négocier pour y avoir elles aussi accès, contribuant là aussi à attiser le FUD de ce côté-ci de l’Atlantique au sujet de la suprématie états-unienne, et de l’isolationnisme de l’administration Trump. Sécurité Mythos : l’Europe tenue à l’écart du modèle IA le plus ambitieux du moment Mercredi 15 avril 2026 à 10h33 15 Signe de l’ampleur de la fébrilité générée par Mythos : quelques semaines seulement après avoir menacé de black-lister Anthropic, la Maison-Blanche conviait la semaine dernière son CEO Dario Amodei, après que l’administration Trump eut « reconnu le pouvoir » de Mythos, rapporte Axios. Un porte-parole de la Maison-Blanche a confié à Politico que le PDG d’Anthropic y avait rencontré de hauts responsables américains et « évoqué les possibilités de collaboration ». Selon Bloomberg, l’Office of Management and Budget, en charge des agences fédérales, a déjà informées ces dernières qu’il s’apprêtait à leur donner accès à Mythos, afin qu’elles puissent se préparer. Dans le même temps, Anthropic « affronte l’administration Trump devant les tribunaux pour avoir mis sur liste noire son modèle d’IA Claude », relève CNN. IA Derrière la polémique entre Trump et Anthropic, les enjeux de l’usage militaire de l’IA Lundi 02 mars 2026 à 17h40 11 Il faudra cela dit attendre trois mois pour mesurer l’ampleur des dommages potentiels, Anthropic ayant annoncé qu’elle « rendra compte publiquement dans un délai de 90 jours des enseignements tirés, ainsi que des vulnérabilités corrigées et des améliorations apportées qui peuvent être divulguées ». « Observant les réactions variées – allant de la panique au déni – à la suite des annonces autour de Mythos », le Conseil de l’intelligence artificielle et du numérique (CIANum), coprésidé par Guillaume Poupard, ex-patron de l’ANSSI, vient de publier une note appelant à « ne pas céder à la panique ambiante », et faisant clairement le lien entre l’annonce de Mythos Preview et le projet d’introduction en bourse d’Anthropic : « Vanter la “dangerosité” de ses modèles s’ils tombent entre de mauvaises mains est une manière habile de mettre en avant leurs performances et de susciter un vif intérêt, y compris du côté des investisseurs. » IA Anthropic, OpenAI, Google : entre stratégie de conquête et manœuvres financières Jeudi 04 décembre 2025 à 17h58 2 « La méthode n’est pas nouvelle », poursuit le CIANum, qui rappelle qu’en février 2019, OpenAI avait lui aussi affirmé que son modèle GPT 2.0 était « trop dangereux » pour être rendu public, avant de finalement le rendre public six mois plus tard, validant, là encore, la stratégie du FUD : Il reste 48% de l'article à découvrir. Déjà abonné ou lecteur ? Se connecter Soutenez un journalisme indépendant, libre de ton, sans pub et sans reproche. Accédez en illimité aux articles Profitez d'un média expert et unique Intégrez la communauté et prenez part aux débats Partagez des articles premium à vos contacts Abonnez-vous

|

Scooped by

Yannick Giquel

Today, 9:52 AM

|

C'est un benchmark d’un nouveau genre. Selon une étude scientifique publiée le 23 avril 2026, certains modèles de langage (LLM) peuvent activement renforcer les croyances délirantes de leurs utilisateurs.

|

Scooped by

Yannick Giquel

Today, 9:39 AM

|

Formation : A partir de la rentrée 2026, l'université Paris 1 Panthéon-Sorbonne ouvre le Collège de l'IA à ses étudiants. Ce diplôme universitaire de niveau...

|

Scooped by

Yannick Giquel

Today, 9:39 AM

|

Au Royaume-Uni, les petites amies virtuelles séduisent de plus en plus les adolescents. Mais derrière ces relations sans rejet, sans conflit et toujours disponibles, les experts redoutent une génération plus douée pour séduire les chatbots que pour affronter les humains.

|

Scooped by

Yannick Giquel

Today, 8:24 AM

|

Tesla engage jusqu’à 2 milliards de dollars dans une acquisition IA révélée discrètement dans un document officiel.

|

Scooped by

Yannick Giquel

Today, 7:09 AM

|

Une industrie qui investit davantage pour échouer davantage : en 2024, l'intelligence artificielle a absorbé 252 milliards de dollars d'investissements mondiaux, quand plus de 8 projets sur 10 n'atteindront jamais la production, soit le double du taux d'échec des projets informatiques classiques.

|

Scooped by

Yannick Giquel

Today, 5:37 AM

|

Dans un article publié sur Wired, le journaliste américain Evan Ratliff raconte comment il a monté une startup entièrement pilotée par des agents IA.Parmi eux, on retrouve Kyle, CEO virtuel, devenu influenceur LinkedIn pendant cinq mois, jusqu'à ce que la plateforme l'invite à prendre la parole devant...

|

Scooped by

Yannick Giquel

Today, 5:22 AM

|

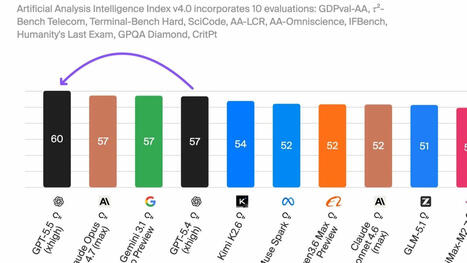

OpenAI vient d'annoncer GPT-5.5, son modèle d'intelligence artificielle le plus avancé à ce jour. Face à la montée en puissance d'Anthropic sur le marché professionnel, la start-up de Sam Altman contre-attaque avec un modèle taillé pour les usages pro les plus exigeants, et franchit une nouvelle...

|

Scooped by

Yannick Giquel

Today, 2:37 AM

|

Plus performant sur les tâches cognitives et la cybersécurité, le nouveau modèle d’OpenAI entend reprendre l’avantage face à Claude Opus 4.7. Mais sur le terrain très stratégique du codage, Anthropic conserve une longueur d’avance.

|

Scooped by

Yannick Giquel

Today, 1:22 AM

|

À l’occasion de l’AWS Summit, le promoteur immobilier Nexity a détaillé sa stratégie en matière d’intelligence artificielle générative.

|

Scooped by

Yannick Giquel

April 23, 4:37 PM

|

OpenAI déploie une version de ChatGPT spécialement conçue pour les cliniciens. Cet outil rend leur travail bien facile que jamais.

|

Scooped by

Yannick Giquel

April 23, 3:09 PM

|

Deux jours après le lancement réussi du nouveau générateur d'images ChatGPT Images 2.0, OpenAI dévoile GPT-5.5, autrefois connu sous le nom de code « Spud ». Un modèle pensé pour agir de manière autonome et qui a pour lourde tâche de reprendre la couronne à Anthropic… quitte à faire gonfler les...

|

|

Scooped by

Yannick Giquel

Today, 11:22 AM

|

Google améliore sensiblement le coach IA intégré aux produits Fitbit. Par ailleurs, le service Fitbit Premium pourrait bientôt être remplacé par Google Santé.

|

Scooped by

Yannick Giquel

Today, 11:22 AM

|

Clutch dévoile la première app marketplace B2B sur ChatGPT - Les échanges avec l’IA deviennent un point d’entrée stratégique pour les décisions B2B.Avec son application intégrée à ChatGPT, Clutch transforme ces...

|

Scooped by

Yannick Giquel

Today, 9:39 AM

|

Intelligence artificielle : Le fournisseur a présenté son dernier modèle qui affiche de meilleures performances en mathématiques et en codage que son concurrent Opus 4.7...

|

Scooped by

Yannick Giquel

Today, 9:39 AM

|

Meta va supprimer 10 % de ses effectifs en mai pour financer ses investissements colossaux dans l'intelligence artificielle.

|

Scooped by

Yannick Giquel

Today, 9:39 AM

|

Emmanuel Marill, ex-patron d'Airbnb en Europe, prend les commandes d'Open AI pour la région EMEA. Un poste nouvellement créé et basé à Paris.

|

Scooped by

Yannick Giquel

Today, 7:09 AM

|

DeepSeek a encore frappé. Celui-ci vient de lancer la nouvelle famille de modèles ouverts DeepSeek V4, dont les performances se rapprochent de celles des modèles d’OpenAI, Google et Anthropic.

|

Scooped by

Yannick Giquel

Today, 5:55 AM

|

Cloud : Le fournisseur a présenté une architecture unifiée de sa plateforme de données pour apporter davantage de contexte métier et d'analyse sémantique aux...

|

Scooped by

Yannick Giquel

Today, 5:22 AM

|

Après avoir fait trembler la Silicon Valley en janvier 2025, le laboratoire chinois DeepSeek publie DeepSeek-V4-Preview, une famille de deux modèles open weight capables de rivaliser avec les meilleurs modèles propriétaires américains pour une fraction de leur coût.

|

Scooped by

Yannick Giquel

Today, 5:22 AM

|

DeepSeek a dévoilé deux nouveaux modèles : DeepSeek V4 Flash et DeepSeek V4 Pro. Ce dernier serait capable de traiter 1 million de caractères en un coup. Ce lancement s'inscrit dans la compétition entre la Chine et les États-Unis dans le domaine de l'IA open source.

|

Scooped by

Yannick Giquel

Today, 2:37 AM

|

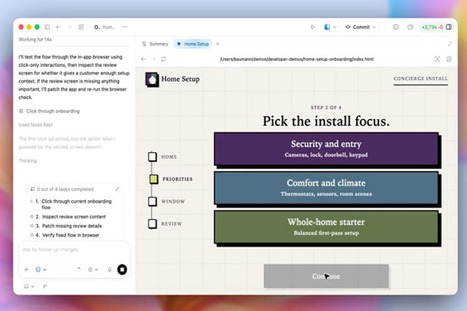

GPT-5.5, Privacy Filter, ChatGPT Images 2.0 : OpenAI fait feu de tout bois Y en a un peu plus, je vous le mets quand même ? On n’en est pas à un nouveau LLM par jour, mais pas loin ! OpenAI a dévoilé GPT-5.5, alors que son prédécesseur GPT-5.4 remonte à début mars. Cette nouvelle version s’ajoute au lancement de ChatGPT Images 2.0 il y a quelques jours, et à celui de Privacy Filter qui masque les données personnelles dans du texte. Mickael Bazoge Le 24 avril à 08h08 IA et algorithmes 5 min Il se passe toujours quelque chose chez OpenAI. Tenez, la startup a lancé cette nuit GPT-5.5, nouvelle version du grand modèle de langage qui propulse, entre autres, ChatGPT. Comme GPT-5.4 lancé le 5 mars, cette mouture est censée accélérer les tâches de productivité. Y compris quand la requête n’est pas tout à fait claire : « Vous pouvez confier à GPT-5.5 une tâche complexe et mal structurée, composée de plusieurs volets, et lui faire confiance pour planifier, utiliser des outils, vérifier son travail, composer avec l’incertitude et poursuivre le travail jusqu’au bout ». IA OpenAI sort GPT-5.4, avec deux versions tournées vers les tâches « professionnelles » Vendredi 06 mars 2026 à 07h47 10 OpenAI promet une amélioration sensible dans les capacités de raisonnement dans un contexte donné : en code agentique, en utilisation de l’ordinateur, dans le travail intellectuel et les premières étapes de la recherche scientifique. La société assure en outre que GPT-5.5 conserve la même latence par token que GPT-5.4, « tout en offrant un niveau d’intelligence supérieur ». GPT-5.4 reste nettement moins cher à l’unité, avec un coût de 2,50 dollars en entrée et 15 dollars en sortie par million de tokens. GPT-5.5 double ces tarifs, mais le modèle compense par une plus grande efficacité, selon OpenAI : il utilise moins de tokens pour effectuer les mêmes tâches. Et ce serait aussi le cas dans Codex. IA Claude Opus 4.7 : le nouveau modèle d’Anthropic se veut plus performant et plus gourmand Vendredi 17 avril 2026 à 07h51 9 Les benchmarks publiés par OpenAI indiquent un bond réel dans les tâches agentiques : GPT-5.5 creuse nettement l’écart avec son prédécesseur direct et ses concurrents sur Terminal-Bench, qui mesure la capacité à utiliser un ordinateur, enchaîner des actions, planifier et corriger ses erreurs. Sur les tests de torture plus classiques, la progression du LLM est incrémentale avec des gains modérés sur GDPval (tâches professionnelles réelles) et OSWorld (usage d’un ordinateur). GPT-5.5 est en phase de déploiement pour les abonnés payants (Plus, Pro, Business, Enterprise) et dans Codex. GPT-5.5 Pro l’est également pour les utilisateurs Pro, Business et Enterprise. L’API y aura droit très bientôt. ChatGPT intègre la déclinaison Thinking de GPT-5.5 dans les formules Plus, Pro, Business et Enterprise. Privacy Filter masque les informations privées L’entreprise a également présenté un modèle tout à fait inédit, OpenAI Privacy Filter, dont la mission est de détecter et de supprimer des données personnelles (PII) dans du texte. Le modèle doit comprendre le contexte linguistique, identifier des informations personnelles (même implicites) et distinguer ce qui est public de ce qui relève de la vie privée. Dit autrement, ce filtre de confidentialité ne se contente pas de repérer des informations basiques comme « @exemple.com » ou un numéro de téléphone. Il est en mesure de décider si cette information doit être masquée, en fonction de l’usage. Le modèle peut être exécuté en local : pas besoin d’envoyer le texte contenant des données sensibles sur un serveur, tout est fait par l’appareil. Par conséquent, il s’agit d’un modèle relativement petit (1,5 milliard de paramètres, dont 50 millions sont actifs) qui peut tout de même traiter des documents relativement longs, jusqu’à 128 000 tokens. Privacy Filter couvre huit catégories de données : personnes privées, adresses, emails, téléphones, URL, dates privées, numéros de compte et secrets (mots de passe, clés API, etc.). Attention cependant, ce n’est pas un outil d’anonymisation complet : il peut en effet se tromper et il nécessite absolument une validation humaine dans les cas sensibles. Le modèle est publié en poids ouverts sous licence Apache 2.0, sur Hugging Face et GitHub. OpenAI le propose à des fins d’expérimentation, de personnalisation, mais aussi dans le cadre d’un déploiement commercial. Privacy Filter est conçu pour s’intégrer dans les bases de données indexées, les outils d’analyse ou de support client, les systèmes de logs ou dans les pipelines d’entraînement de modèles. ChatGPT Images 2.0, toujours plus loin dans le faux Si OpenAI a abandonné ses prétentions en matière de génération vidéo en fermant Sora sans cérémonie, la génération d’images, elle, est toujours aussi importante. L’entreprise a lancé le 21 avril ChatGPT Images 2.0, un peu plus d’un an après la première version. Le nouveau modèle est censé respecter scrupuleusement les instructions, qu’il s’agisse de placement et de relation entre les objets, ou de rendu de textes denses. Images 2.0 devrait donc se montrer plus doué pour générer des bandes dessinées en respectant le look des personnages d’une case à une autre, des pages de magazine avec une typographie correcte, mais aussi des interfaces d’applications et de jeux, des storyboards et des assets marketing. Une des nouveautés intéressantes d’Images 2.0 : le mode « Thinking » du modèle peut effectuer des recherches en ligne pour obtenir des informations en temps réel, créer plusieurs images distinctes à partir d’une seule requête, et vérifier ses propres résultats. Les images générées, que l’on peut modifier et affiner, peuvent monter à une résolution 2K. OpenAI fait enfin une sacrée promesse, celle que les images générées par Images 2.0 fassent moins « générées par IA » — floutant un peu plus la frontière entre le vrai et le faux.

|

Scooped by

Yannick Giquel

April 23, 6:07 PM

|

Découvrez comment Anduril et l’US Army s’unissent pour transformer la défense grâce aux drones autonomes et à l’IA.

|

Scooped by

Yannick Giquel

April 23, 3:22 PM

|

Après avoir lancé sa réponse à Nano Banana, OpenAI lance GPT-5.5. Les améliorations se concentrent sur la productivité, afin de permettre à ChatGPT de repasser devant Claude.

|

Your new post is loading...

Your new post is loading...